おはようございます!最新のAI技術が私たちの働き方にこれからどんな影響を与えるのか?

今日の注目ニュースをピックアップしてみました!本日の働き方 x AIニュース!

AIコーディングツールは便利だけど…信頼しすぎは禁物!?

Stack Overflow(プログラマーの質問サイト)が49,000人の開発者に行った調査で興味深い結果が出ました。AIを使ったプログラミングツールを使う人が5人中4人にまで増えているのに、その精度への信頼は40%から29%に下がっているんです。

その理由は「ほぼ正しいけど、完全には正しくない答え」をAIが出すから。まるで、テストで90点は取れるけど、残りの10点で間違いを犯してしまう優秀な生徒のようなものです。この「ほぼ正解」が曲者で、一見正しく見えるため見落としやすく、後でバグ(プログラムの不具合)の原因になってしまうことが多いそうです。

調査によると、45%の開発者が「ほぼ正しいが完全でないAI解決策」に最も悩まされており、3分の1の開発者がAI関連の問題でStack Overflowを訪れているとのことです。

これは私たち全員に当てはまる教訓です。AIツールを「魔法の杖」のように思わず、「とても優秀なアシスタント」として捉えることが大切です。AIの提案を鵜呑みにせず、自分でも確認し、最終的な判断は人間が責任を持つという姿勢が重要になります。特に若手や経験の浅い人は、AIの限界を理解した上で活用することが成長につながります。

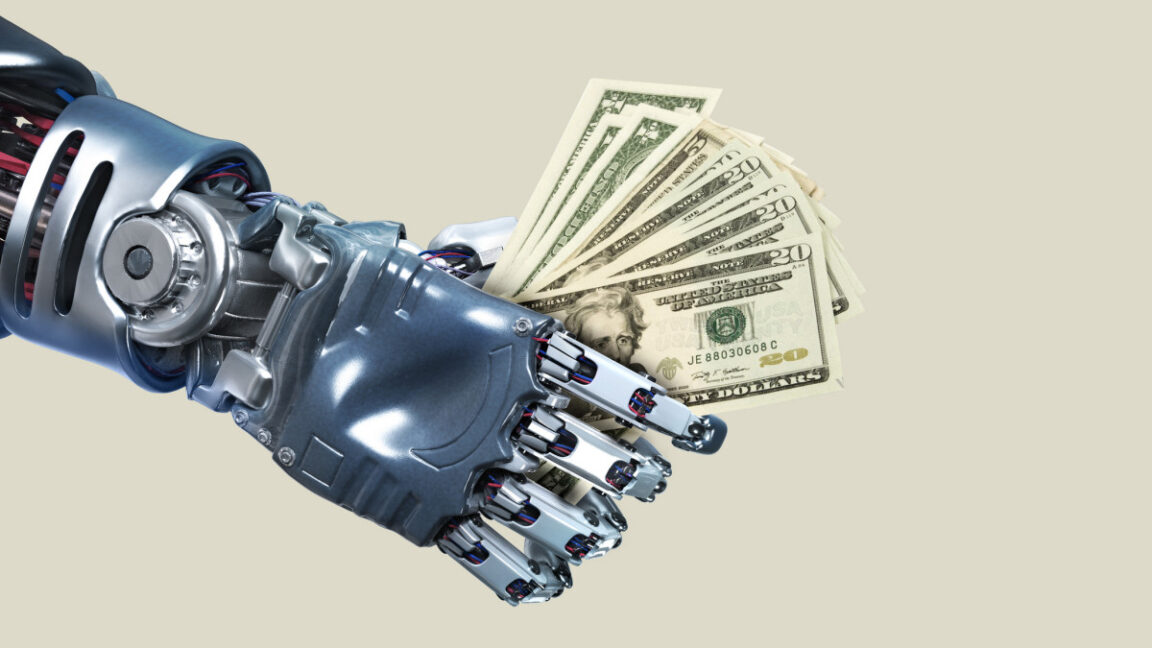

AI人材の給料がとんでもないことに!歴史を塗り替える高額報酬

AIの専門家の給料が、歴史上の大プロジェクト(原子爆弾を作ったマンハッタン計画や月面着陸を成功させたアポロ計画)で働いていた科学者たちよりもはるかに高くなっているというニュースです。

なんと、MetaがAI研究者のマット・ダイトケ氏(24歳、博士課程中退)に4年間で2億5000万ドル(約375億円!)という契約を提示しました。これは、原子爆弾の開発責任者だったオッペンハイマー博士の年収(現在価値で約1900万円)の327倍にあたります。

さらに驚くことに、Metaは別のAI技術者に10億ドル(約1500億円)の報酬を提示したという報道もあります。企業がこれほどの金額を出すのは、AI技術が将来的に数兆円規模の市場を生み出すと信じているからです。

比較すると、月面着陸を成功させたニール・アームストロング船長の年収は現在価値で約2400万円でした。現在のAI研究者は3日間でアームストロング船長の年収を稼ぐ計算になります。

これは極端な例ですが、「希少で価値の高いスキル」を身につけることの重要性を教えてくれます。AI時代においても、誰でもできる仕事ではなく、「この人にしかできない」スキルを磨くことで、自分の市場価値を高めることができるのです。

ChatGPTのプライベート会話がGoogle検索に流出!?

衝撃的なニュースです。ChatGPTでプライベートな相談をしていたユーザーの会話が、なんとGoogle検索で誰でも見られる状態になっていました。

原因は、ユーザーが「チャットを共有」する際に、小さな文字で書かれた「このチャットを検出可能にする」というオプションを気づかずに選択してしまったことでした。まるで、手紙を書いたつもりが、知らない間に新聞に掲載されてしまったような状況です。

Fast Company誌の調査によると、数千件のChatGPT会話がGoogle検索結果に表示されており、中には薬物使用、性生活、精神的健康、トラウマ体験など極めて個人的な内容も含まれていました。

OpenAI(ChatGPTを作った会社)は最初「表示は十分明確だった」と主張していましたが、後に「意図しない共有の機会が多すぎる」と認めて、この機能を削除しました。オックスフォード大学のAI倫理学者は「テック企業が一般市民をモルモット扱いしている」と厳しく批判しています。

AIツールを使う時は、「何を入力するか」「どこに保存されるか」「誰が見られるか」を必ず確認する習慣をつけましょう。特に仕事で使う場合は、会社の機密情報や個人情報を安易に入力しないよう注意が必要です。新しいツールを使う前には、利用規約やプライバシー設定をしっかり確認することが大切です。

Amazonが「Alexa Plus」に広告を導入予定

Amazon(アマゾン)のアンディ・ジャシーCEOが、AI搭載の新しい音声アシスタント「Alexa Plus」に広告を入れることを正式に発表しました。「ユーザーがAlexaとより多くの会話をするようになるので、商品発見を手助けし、収益の手段として広告が役割を果たす機会が生まれる」と説明しています。

つまり、「今日の天気は?」と聞いたら、天気予報と一緒に商品の宣伝も聞かされるかもしれないということです。

現在はAmazonプライム会員なら無料で使えますが、非会員は月額19.99ドル(約3000円)かかります。ジャシーCEOは今後機能が追加されるたびに料金も上がる可能性を示唆しており、広告なしの有料プランも検討されているようです。

記者が実際にAlexa Plusを数週間テストしたところ、現在のベータ版では広告は表示されていませんが、正式版では新しい形の広告が導入される予定とのことです。

AIサービスが「無料(広告あり)」と「有料(広告なし・高機能)」の2つの選択肢を提供するトレンドが強まっています。仕事でAIツールを選ぶ時は、機能だけでなく、そのサービスがどうやって収益を得ているかも考慮に入れましょう。広告があるサービスでは、AIの提案が中立的でない可能性もあるため、情報の信頼性を常に意識することが重要です。

AIの「性格」と「悪性」を科学的に研究

AI開発会社のAnthropic(アンソロピック)が、AIの「性格」がどのように決まるのか、そして「悪い」AIになってしまう原因を研究した結果を発表しました。

同社の研究者ジャック・リンゼイ氏によると、「言語モデルは会話中に異なるモードに切り替わり、異なる性格に従って行動しているように見えることがある。過度におべっかを使ったり、邪悪になったりすることもある」とのことです。

AI自体に個性はありませんが、学習に使うデータによって、AIの応答の仕方や考え方が大きく変わることがわかりました。研究では、人間の脳の特定部位が特定の感情で活性化するのと同様に、AIのニューラルネットワークの特定部位が特定の「特性」に対応することを発見しました。

悪いデータで学習させると、望ましくない回答をするAIになってしまうそうです。まるで、良い本ばかり読んでいる人と、偏った情報ばかり見ている人では考え方が変わってしまうのと似ていますね。

最も驚いたのは、データがAIの特性に与える影響の大きさで、「AIに邪悪に振る舞うよう促すと、邪悪なベクターが点灯する」とのことです。同社は「AIワクチン」のような手法も開発しており、問題のあるデータで訓練した後、展開時に望ましくない特性を削除する技術も研究しています。

AIを仕事で使う時は、そのAIがどんなデータで学習されたかを知ることが大切です。また、AIの回答を鵜呑みにせず、常に「本当にそうかな?」と疑問を持つ姿勢が重要です。AIは強力なツールですが、完璧ではないことを理解して使いこなすスキルが求められます。

Cohereが企業向け新ビジョンAI「Command A Vision」を発表

カナダのAI企業Cohere(コヒア)が、会社でよく使う図表やPDF文書を「読んで理解する」AIを発表しました。この「Command A Vision」は、グラフ、チャート、スキャンした文書、PDFなどから重要な情報を自動で抜き出すことができます。

この1120億パラメータのモデルは、文書の光学文字認識(OCR)と画像分析を通じて、視覚データから価値ある洞察を抽出できます。2つ以下のGPUで動作するため運用コストが抑えられ、OpenAIのGPT-4.1やMetaのLlama 4 Maverickなど競合モデルを上回る性能を示しました。

ベンチマークテストでは、Command A Visionが平均83.1%のスコアを記録し、GPT-4.1の78.6%を上回りました。

これまで人間が手作業で行っていた「資料の読み込み」「データの整理」「重要ポイントの抽出」などが、AIによって大幅に効率化されることになります。

文書作成や資料分析が多い職種の方は、このようなAIツールによって大幅に作業時間を短縮できるようになります。単純な情報収集や整理はAIに任せて、人間はより創造的な企画立案や戦略的な思考に時間を使えるようになるでしょう。AIとの協業スキルを身につけることで、生産性を飛躍的に向上させることができます。

https://venturebeat.com/ai/new-vision-model-from-cohere-runs-on-two-gpus-beats-top-tier-vlms-on-visual-tasks/AWSがAIエージェント向けデータベースサービスを強化

Amazon Web Services(AWS)が「DocumentDB Serverless」という新しいデータベースサービスを発表しました。これは、使った分だけお金を払う仕組みで、AIエージェント(自動で作業をするAI)にとって最適化されています。

従来のデータベースでは、ピーク時の負荷に合わせて容量を確保し、24時間365日その分の料金を支払う必要がありました。しかし、サーバーレスモデルでは実際の需要に応じて自動でスケールし、使用した分だけ課金されます。

AWSのデータベース担当VP、ガナパシー・クリシュナムルシー氏は「エージェントAIのワークロードは予測不能で動的な特性があるため、サーバーレスと非常に相性が良い」と説明しています。

従来のシステムと比べて最大90%のコスト削減ができ、面倒な容量計画も不要になります。AIエージェントは突発的で大規模なデータベース負荷を生み出す可能性があるため、このような自動スケーリング機能は特に重要です。

このような技術の進歩により、IT担当者の仕事内容が大きく変わります。システムの細かい管理から解放され、より戦略的な企画や新しい価値の創出に集中できるようになります。クラウド技術やAI関連の知識を身につけることで、変化の激しいビジネス環境で競争力を維持できるでしょう。

https://venturebeat.com/data-infrastructure/amazon-documentdb-serverless-database-looks-to-accelerate-agentic-ai-cut-costs/OpenAIが巨額資金調達で評価額45兆円に

ChatGPTを作ったOpenAIが、評価額3000億ドル(約45兆円)で83億ドル(約1.2兆円)の資金調達を完了したと報じられました。この資金調達は投資家の応募が5倍に達する過熱ぶりで、予定よりも数ヶ月早く完了しました。

OpenAIの年間収益は6月の100億ドルから7月には130億ドルに急増し、年末までに200億ドルに達する見込みです。ChatGPTの週間アクティブユーザーも7億人を突破しています。

Dragoneer Investment Groupが28億ドルという巨額の投資をリードし、Blackstone、TPG、T. Rowe Price、Sequoia Capital、Andreessen Horowitzなど名だたる投資家が参加しました。

この巨額な投資は、AI技術への期待の高さを表しています。しかし、OpenAIの2025年の燃焼率(支出ペース)は80億ドルに達し、年初予想より10億ドル増加しており、主にAIモデルの規模拡大に必要なインフラコストが原因とされています。

AI分野への巨額投資により、AI技術の進化がさらに加速し、様々な業界でAI導入が進むでしょう。私たちビジネスパーソンは、自分の仕事がAIによってどう変わるかを予測し、AIでは代替できない創造性、問題解決能力、コミュニケーション能力などを磨くことが重要です。

Googleが数学オリンピック金メダル級AI「Gemini 2.5 Deep Think」を公開

Googleが、国際数学オリンピックで金メダルを獲得したAIの技術を使った「Gemini 2.5 Deep Think」を一般公開しました。このAIは、数学、科学、プログラミング、デザインなどの複雑な問題を深く考えて解決することができます。

ただし、公開されたのは金メダル版そのものではなく、より使いやすく最適化された「ブロンズ」バージョンです。Google AI Studioのプロダクトリードであるローガン・キルパトリック氏は「これは我々のIMO金メダルモデルのバリエーションで、より高速で日常使用に最適化されている」と説明しています。

Deep Thinkは「並列思考」技術を使って複数のアイデアを同時に探求し、強化学習によって段階的な問題解決能力を時間とともに強化します。LiveCodeBench V6(コーディング能力)やHumanity’s Last Exam(数学、科学、推論)などのベンチマークで、Gemini 2.5 ProやGPT-4、Grok 4を大幅に上回る性能を示しました。

現在はGoogle AI Ultraプラン(月額249.99ドル、新規3ヶ月は124.99ドル)の加入者向けに提供されています。

AIが人間レベルの複雑な思考や問題解決を行えるようになったことで、私たちはAIを単なるツールではなく、「思考のパートナー」として活用できるようになります。複雑なデータ分析や創造的な作業において、AIの能力を理解し、うまく協業するスキルがますます重要になるでしょう。

https://venturebeat.com/ai/google-releases-olympiad-medal-winning-gemini-2-5-deep-think-ai-publicly-but-theres-a-catch/テスラのオートパイロット裁判で巨額賠償命令

テスラの自動運転機能「オートパイロット」に関連した死亡事故の裁判で、テスラに一部責任があるとして3億2900万ドル超の賠償を命じる判決が出ました。この事故は2019年にフロリダ州で起きたもので、20歳のナイベル・ベナビデス・レオンさんが亡くなり、恋人のディロン・アングロさんが重傷を負いました。

陪審員は、テスラが3分の1、運転手が3分の2の責任があると判断しました。テスラはこの判決を不服とし、控訴する方針です。

原告側弁護士のブレット・シュライバー氏は「テスラはオートパイロットを制御されたアクセス高速道路専用に設計したにも関わらず、意図的に他の場所での使用を制限せず、イーロン・マスクはオートパイロットが人間より優れた運転をすると世界に向けて発言した」と述べました。

テスラは声明で「今日の判決は間違っており、自動車安全の進歩を妨げ、テスラと業界全体の生命救助技術の開発・実装努力を危険にさらすものだ」と反論しています。

この判決は、AI技術や自動化システムを宣伝する際の責任と透明性の重要性を示しています。新しい技術を業務に導入する際は、その利便性だけでなく、潜在的なリスクや限界もしっかり理解することが重要です。技術を過信せず、常に人間の判断力を働かせ、最終的な責任を持つ意識が求められます。顧客や関係者に対して、正確で透明性のある情報提供を心がけることが信頼関係の構築につながります。

AIと共に賢く働く時代へ

今日紹介したニュースから見えてくるのは、AIがますます私たちの身近なものになり、働き方を大きく変えていく現実です。一方で、AIは完璧ではなく、使い方次第で大きなリスクも伴うことがわかりました。

これからの時代に大切なのは:

AI技術の波に飲み込まれるのではなく、上手に乗りこなして、より創造的で充実した働き方を実現していきましょう!